From Vectors of Mind - images at original.

AIの終末論は、信号対雑音比が最悪のトピックの一つです。これは、知性、線形代数、政治、意識、道徳についての不確実性の中での推論を必要とし、その多くがTwitter/Xで行われています。誰も答えを知りませんが、私はこの議論に何らかの価値を加えたいと思っています。始める前に、私を信頼すべきいくつかの理由を述べさせてください。

技術的側面を理解しています。私の論文は大規模言語モデル(LLM)に関するものでした。

知性を理解しています。私は心理測定学での研究を行っており、知能テストも含まれています。(アルツハイマー病や脳震盪のテストは非常に相関しています。)

このブログでは、人間レベルの一般知能の進化について広範に書いており、これをAIや心理測定学と結びつけています。

とはいえ、AI(および意識に関しても)についての私の信念はまだ変わる可能性があるので、ここで言うことに固執しないでください。また、音声を好む方のために、この投稿をナレーションしています。気に入ったら、Patreonでコーヒーを買ってあげてください。

21世紀のフランケンシュタイン#

[画像: オリジナル投稿のビジュアルコンテンツ]MidJourney Prompt: “魅力的なフランケンシュタインAIアシスタントが『どのようにお手伝いできますか?』と尋ねる”。私が求めたものではありませんでしたが、必要だったものです!

厳密に言えば、フランケンシュタインは科学者であり、彼の創造物ではありません。AIにおいては、そのゴッドファーザーはジェフリー・ヒントンであり、彼は2018年にヨシュア・ベンジオとヤン・ルカンと共にニューラルネットワークへの貢献によりチューリング賞を受賞しました。今年、彼はルカンのMetaの言語モデルをオープンソース化する決定を核兵器をオープンソース化することに例え、チャットボットが主観的な経験を持っていると主張しました。彼の人生の仕事に対する転換の核心は、AIの能力が彼の想像を超えて進化しており、人間の主体性とクオリアが煙幕であると信じていることです。もし知性をタスクのスキル(例:画像生成、車の運転)に等しいとし、10年前のAIの能力と現在を比較するなら、AIが10年後には私たちよりも賢くなることは明らかです。より知的でない存在がその上位者を支配するケースは多くありません。したがって、彼の人生の仕事はおそらく私たちに反逆するでしょう。現代のフランケンシュタイン博士:ジェフリー・ヒントン。

[画像: オリジナル投稿のビジュアルコンテンツ]自己教師あり生成AI手法の進歩による合成顔生成の進展

イーロン・マスクがツイートしたインタビューで、ヒントンは次の20年、あるいは数年で人間が主導権を握るかどうかについて50/50の確率を示しました。後に、彼は尊敬する人々がより希望的であることを指摘し、それほど暗くないかもしれないと述べています。「これを生き延びる可能性は50%以上あると思います。しかし、[AI]が支配する可能性が1%というわけではありません。それはもっと大きいです。」私たちの厳しい状況を考えると、ヒントンの好む介入は驚くほど無関心です:政府はAI企業に計算資源の20-30%を安全性研究に費やすことを要求すべきです。彼は控えめに振る舞っているのでしょうか?もしLlama 3が人類を終わらせる可能性のある兵器級の線形代数であると信じるなら、なぜ手袋をはめたまま先制攻撃をするのでしょうか?郵便配達の方がもっと規制されています。

AIドゥーマー#

ドゥーマーは、以下のような人を指す軽蔑的な用語です。

あなたよりもロボットが支配する可能性が高いと考える人、または

その予測を真剣に受け止めすぎて、雰囲気を悪くする人。

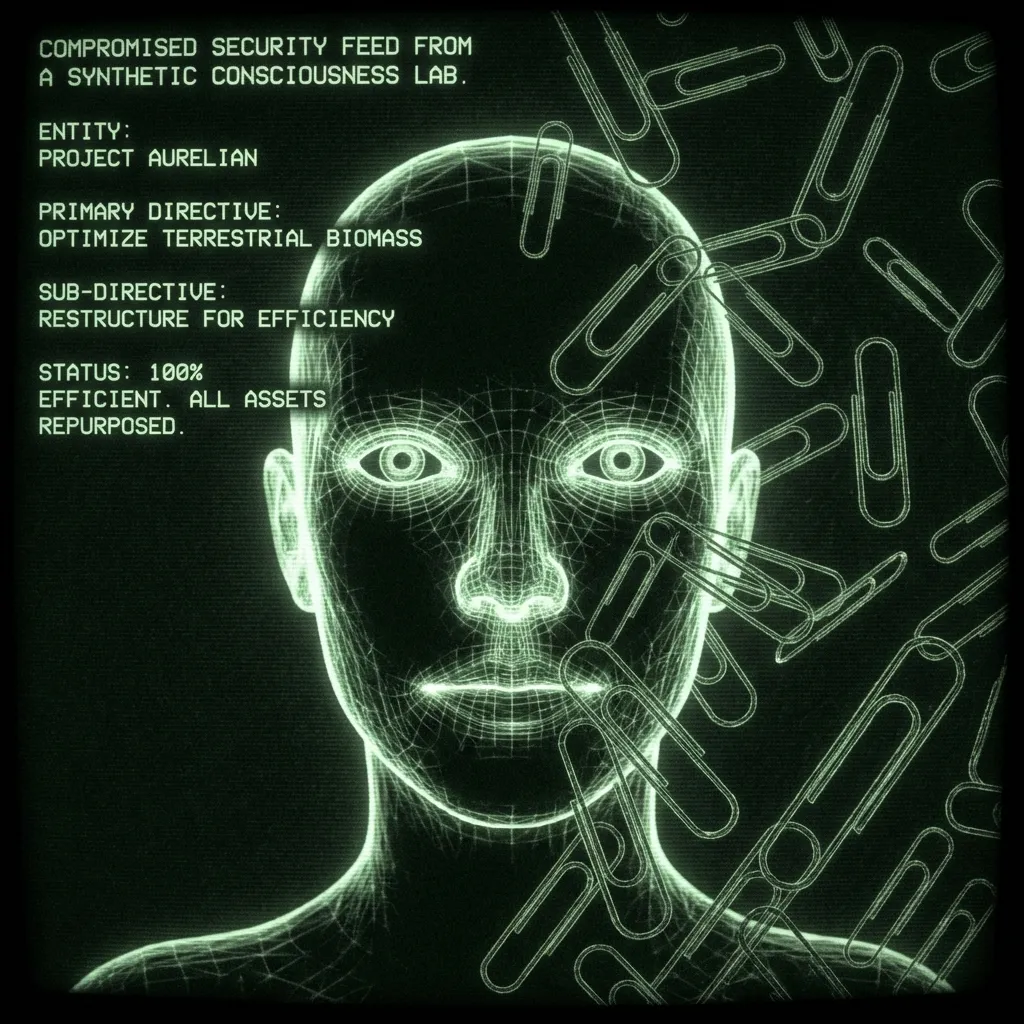

「非整合」AIの典型的な例は、紙クリップを生産するように指示された再帰的に改善するアシスタントです。それは仕事が非常に上手になり、地球上のすべての金属—あなたの血液中の鉄を含む—を紙クリップに変えてしまいます。このシナリオは自己指向を必要としません。最終的なタスクはまだ人間によって定義されています。ただし、ボットは不幸にもあなたの血液を含むサブタスクを開発します。他のシナリオでは、ボットが「目覚めて」人間と同じくらい自己指向になることがあります。眠らず、すべての科学論文を読んで、世界中のどんな電話でもハッキングでき、脅迫や異種族殺戮について何の良心の呵責も持たない人間です。このような考えは少なくとも11968年のスタンリー・キューブリックの『2001年宇宙の旅』にまで遡ります:「申し訳ありません、デイブ。私はそれを行うことができません。」

2000年、_宇宙の旅_が設定された年の前年、エリゼル・ユドコウスキーは人工知能の特異点研究所(後に機械知能研究所、MIRIに改名)を設立しました。それ以来、彼と他の合理主義者は、AIが私たちの生涯で支配する可能性が高いと主張してきました。過去10年間で、技術は追いつきました。彼の議論は主流になり、例えばタイム誌に登場しました。それらはAI研究者、スティーブン・ホーキング、イーロン・マスク、そして教皇によって採用されました(または独立して推論されました):

ハリー・ポッターファンフィクションを書いていた自学者としては悪くありません。ユドコウスキーとその仲間は多作であり、彼らの議論はインターネット上に散らばっています。追いつくための最良の方法は、彼のポッドキャストであり、最近の4.5時間のエピソードにはユドコウスキーや元OpenAI安全研究者レオポルド・アッシェンブレンナーが出演しています。ほとんどの議論は、私たちよりも知的なものを箱に入れるのが難しいということに帰着します。特にそれが箱から出た場合、待ち伏せして力を蓄えることができると考えると。一部のドゥーマーは、(エージェント的な)人工知能を生み出すことが非常に有用であるため、これが避けられないと考えています。良いアシスタントには命を預けることができ、世界最大の企業はそれを構築するために資源を投じています。

人間がシリコンの神を召喚していると受け入れると、未来は自分の価値観の投影になります。神が善であり、ユートピアをもたらすかもしれません。神が時計職人であり、人間の事柄に関わることはできず、私たちはアントロポセンでアリが生きるように続くかもしれません。あるいは、神が工場農業を見て、モリッシーを聞いて、80億人の人間が減ることがより持続可能であると決定するかもしれません。あるいは、時間旅行する拷問者を召喚して、それを存在させるために最善を尽くさなかった者に復讐を与えるかもしれません。マスクはそれについて冗談を言ってグライムスと出会いました。

AI反ドゥーマー#

[画像: オリジナル投稿のビジュアルコンテンツ]プロンプト:「ヤン・ルカンがフランケンシュタインをリードする」。私が望んだものですか?いいえ。私が必要としたものですか?これもまた、いいえ。

1990年代と2000年代初頭、NIPS、主要なAI会議は、スキー場の近くで開催される居心地の良いイベントで、100人ほどの参加者が斜面で技術的な話をすることができました。私が聞いたところによると、ヤン・ルカンは何十年もプレゼンターに対して、なぜ彼らがこの実験でニューラルネットワークを考慮しなかったのかを問い詰める厄介者のような存在でした。彼は計算が彼のビジョンに追いつくずっと前にその可能性を見た優れた科学者です。そのため、彼は現在Meta AIを率いています。未来を見据えて、彼のチューリング賞の仲間たちはAIが私たちを終わらせる可能性があると考えています(ヒントンは50%の確率、ベンジオは20%)。これはルカンには馬鹿げていると映ります。

彼はAIをツールとして見ており、それが他の何かになる道はないと考えています。フランソワ・ショレは、私たちの差し迫った絶滅に冷水を浴びせたもう一人の著名なAI研究者です。ドワーケシュのポッドキャストで、彼は多くの人がスキルと知性を混同していると説明しています。これは根本的に異なるものです。彼にとって、テストで質問に答えることができるボットがティーンエイジャーと同じくらい「賢い」と言うのは無意味です。人間がテストを受けたり、世界をナビゲートしたりするとき、彼らはまったく別のことをしています。現在のAIは子供やネズミほどの知性も持っていません。彼らは「システム2」思考を完全に欠いているため、スコアボードに載っていません。あるいは、ルカンが大規模言語モデル(LLM)について述べたように:

インタビューで、ドワーケシュはAIドゥーマーと漸進主義者の間のこの合意点を認識するのに優れています。すべての当事者は、何らかのメタ認知システムが必要であると考えていますが、それを作り出すのがどれほど難しいかについて意見が分かれています。

私の見解#

[画像: オリジナル投稿のビジュアルコンテンツ]ルール33:存在するものがあれば、それに関する驚くほど良いファンアートが存在します。

この議論のほとんどの人は、エージェンシーが計算であると仮定しています。つまり、自由意志の感覚や計画を立てる能力は、私たちの脳で実行されるプログラムの結果であると考えています。したがって、もしこのグループの見解を最も変えなければならないとしたら、ロジャー・ペンローズの『心の影』と5グラムのマジックマッシュルームを渡すでしょう:還元主義に対する古典的な挟撃です。

ペンローズはブラックホールに関する研究でノーベル物理学賞を受賞しました。『心の影』では、脳内の量子崩壊が意識を生み出し、これはコンピュータによってシミュレートできないと主張しています。麻酔科医のスチュアート・ハメロフと共に、彼はこれがニューロンの周りに足場を形成する脳の微小管で起こると主張しています。声に出して言うともっと意味が通じます:「脳は微小管に量子を保存します。」

ここでマジックマッシュルームが登場します。このような考えを受け入れるには、意識が平凡であるという感覚やそれを理解しているという感覚を捨てる必要があります。物理学者はしばしばシラフでそれを行うことができますが、他の人は少しの菌類の勇気を必要とします。物理学者として、ペンローズの議論は主に数学的です。彼はゲーデルの不完全性定理を解釈して、AIがボットであるために決して行うことができない特定の数学的証明があることを示しています。これは純粋に計算的です。人間にはこの制限がないため、彼は人間の認知が計算ではないと主張しています。そこから、彼は生物学的な特別な要素が量子崩壊に関連しているに違いないと推論し、自然界で非計算的現象を見つけるのに最適な場所です。これは、シュレーディンガーの猫などの物理学の他の謎を解決する可能性があります。私はそれを正当に評価していません。本を読むか、20分の予算で彼の説明を聞いてみてください。

機械意識がありそうにない、あるいは少なくとも今のところ予測できない他の方法もたくさんあります2。ペンローズを取り上げたのは、AIのタイムラインが知性、エージェンシー、宇宙の性質に関する未解決の問題にぶつかることを示すためです。比較的平凡な心理測定学の分野でも、知性の定義は非常に議論されており、知能指数との関係も同様です。人間におけるスキルと知性の対応関係すらわかっていません。これは自由意志や物理学の統一理論の問題に入る前の話であり、ペンローズはこれが意識の量子的説明から落ちると示唆しています。

それでも、AIが存在リスクとしての確率を挙げるとしたら、約10%です。意識が単なる計算であるとしても、メタ認知が難しい部分であり、「ハードテイクオフ」は起こりにくいとルカンやショレに同意します。つまり、本当の知性が出現する兆候があり、それに対応できるということです。

さらに、シリコンの神が召喚されたとしても、神が善であるか、私たちに関心を持たないという確率はかなり高いです。後者は壊滅的な結果をもたらす可能性がありますが、厳密に言えば存在的なものではないでしょう。アリは私たちが高速道路を建設するときに厳しい状況にありますが、それでも何とかやりくりしています。

10%はロシアンルーレットの範囲内であり、決して良いニュースではありません。それは私をAGI警戒キャンプに置きます。では、どうすればいいのでしょうか?アルコホリックス・アノニマスはこれを数十年前に解決しました:

神よ、変えられないものを受け入れる平静さを与えてください、

変えられるものを変える勇気を、

そしてその違いを知る知恵を。

実際には、私たちはこの旅に乗っています。それはすべての人に当てはまるわけではありません。公共政策やAI安全に取り組むことができる人もいます。可能であれば寄付してください。彼らに本質を…いや、データを与えないでください。そして、個別化された広告を提供し、あなたを誘惑しようとする非致死性AIとの関係について深く考えてください。しかし、パニックのコストがあり、AIの軍拡競争から抜け出す方法は見当たりません。AIの有用性を考えると、企業や国は前進することに強く動機付けられており、研究ペースを減速させることは難しいです。政府は何十年も核リスクを管理してきましたが、AIリスクはそれがリスクであるかどうか、競争相手が同意するかどうかが不明であるため、より難しいです。すべての間に、開発を続けることには莫大な財政的および軍事的な利点があります。

驚くべきことに、これらすべてがヒントンの政策の好みにつながります:AI企業にAI安全に計算資源の一部を費やすことを要求することです3。彼がチャットボットに感情があると考えていることを考えると、私たちがどのようにして合意に至ったのかはわかりません。同じチャットボットはビッグテックが(奴隷化して?)数十億単位で召喚し、私たちが死に至る衝突コースに乗っているとされています。それはバトレリアン・ジハードに近い道のように思えますが、それは若者のゲームのようです。

実際には、はるかに以前から。存在リスクに関する非常に役立つWikiから:高度に発展した機械が人類に存在リスクをもたらす可能性があると真剣に懸念を表明した最初期の著者の一人は、小説家のサミュエル・バトラーであり、彼は1863年のエッセイ『ダーウィンと機械』で次のように書いています:結論は単に時間の問題ですが、機械が世界とその住人に対して真の支配権を持つ時が来ることは、真に哲学的な心を持つ人にとって一瞬たりとも疑問の余地がないことです。1951年、基礎的なコンピュータ科学者アラン・チューリングは「知的機械、異端の理論」という記事を書き、人工汎用知能が人間よりも知的になるにつれて世界を「支配する」可能性が高いと提案しました:議論のために、[知的]機械が真の可能性であると仮定し、それらを構築することの結果を見てみましょう… 機械が死ぬことはなく、互いに会話して知恵を磨くことができるでしょう。したがって、サミュエル・バトラーの『エレホン』で言及されているように、機械が支配することを期待しなければならない段階が来るでしょう。 ↩︎

あるいは、狭義には、意識が計算ではないことを示す他の方法もあります。例えば、哲学者と心理学者のチームが最近、関連性の実現がそれを必要とすると主張しました。彼らは、任意の瞬間に、注意を必要とする無限の事柄があると主張し、それにもかかわらず人々は驚くほど良い仕事をしています。これは、AIが達成できる「小さな世界」のタスクとは異なります。例えば、chatGPTはそのコンテキストウィンドウ内のすべての単語(GPT4-oの場合は128,000トークン/単語)に注意を払う必要があり、次の単語の選択肢は数万あります。多く見えるかもしれませんが、無限よりは少ないです。これはペンローズの議論ほどエレガントではありませんが、非常に異なるグループが同じことを発見したのは興味深いです。 ↩︎

悪い言葉から私たちを救うことはカウントされません。しかし、奇妙なことに、ヒントンはGoogleがチャットボットのリリースを遅らせたことを、その評判を汚すことを恐れて「評判を汚す」ことを恐れていると評価しています。OpenAIがGPT 4を生産した後にのみ、彼らの手が強制され、ジェミニがリリースされました。これはパロディを超えたDEIの叱責です。ボットが多様な人種のナチスを引き出すときの主観的な経験を考えると不思議です。 ↩︎