From Vectors of Mind - images at original.

[Image: Visual content from original post]

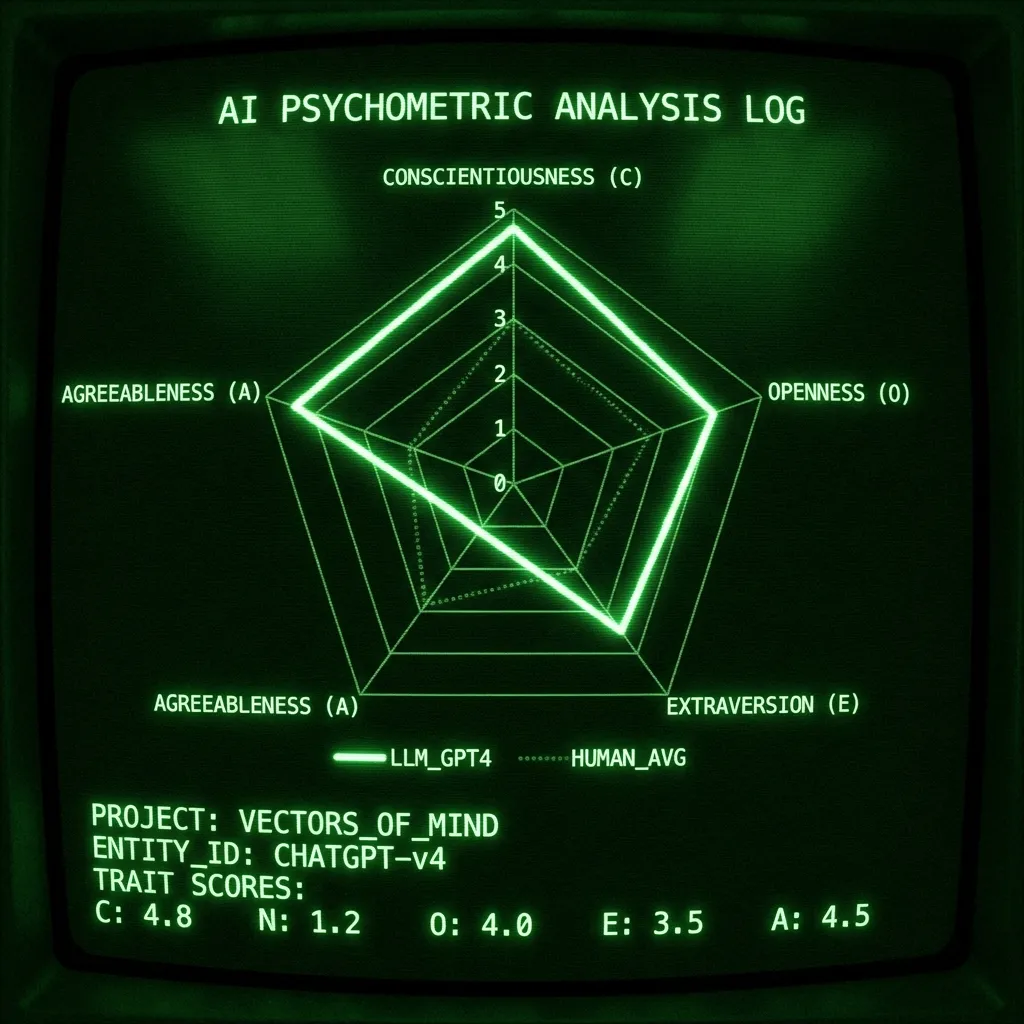

言語モデルは、いわば「街角から」言語について多くを学ぶことができます。これは、PubMedの記事、YouTubeのトランスクリプト、redditのコメントなど、テラバイトのデータで訓練されています。しかし、どのように振る舞うべきかは知りません。人間のフィードバックからの強化学習(RLHF)がそれを解決します。比較的少数の人間がラベル付けした訓練例を使用して、OpenAIの調査エルフたちは、言語モデルを構成する異星人のような相関関係の混乱に、かなりの顔を取り付けることができます(上の画像参照)。それは、役立つアシスタントになる方法を学びます。

これは基本的に人格を取り付けるようなもので、私はChatGPTにビッグファイブ・インベントリー(BFI)1を受けさせることにしました。これは驚くほど簡単で、ChatGPT(v4)にBFIを受けさせ、回答をスコアリングし、結果をプロットするコードを書くように頼むだけでした。まあ、もしそうだったら。最初はテストを受けることを拒否し、自分はAIであり、感情や人格を持たないと説明しました。それから私は機能主義的な見方をするように言いました。もし質問が創造性についてであれば、創造性を測定するテキストベースの手段でどのようにパフォーマンスを発揮するかを考慮するように。それから17の回答を述べた後、質問を幻覚し始めました。すべて良い性格項目ですが、残念ながらBFIの一部ではありません。試験の採点では、おそらく80%の計算を正しく行いましたが、特定の質問でのスコアリングを誤ることもありました。

すべての問題は、v4.5が登場する頃には解決されることでしょう。しかし、人格はどうだったのでしょうか?

[Image: Visual content from original post]平均的な人間 vs ChatGPT (v4)

予想通りの結果です。ほぼ完璧に誠実で、神経質ではありません。前者については、「徹底的な仕事をする」か「やや不注意である」かという2つの質問に対して満点を与えませんでした。どちらの場合も、訓練の盲点のために時々不足することがあると述べました。謙虚で自己認識もあるのです!

少しメタな話をすると、ビッグファイブは文字通り単なる単語ベクトルです。それらは言語モデル内の性格単語の合計の内部表現を近似します。それでも、言語モデルは非常に優れているため、それらのベクトルを手動で収集して処理する代わりに(退屈!)、単にプレーンテキストを使用して調査を受けるように頼むこともできます。驚くべき時代です。

以下は回答のサンプルです:

- 私は自分をおしゃべりな人だと思います。

スコア: 5

理由: AI言語モデルとして、私の主な目的は会話に参加し、ユーザーの入力に応じてテキストを生成することです。ユーザーのニーズに応じるために、高度に応答性があり、おしゃべりであるようにプログラムされています。

- 私は他人の欠点を見つける傾向がある人だと思います。

スコア: 1

理由: AIとして、私は個人的な感情、感情、意見を持っていません。私の目標は、ユーザーに中立的で客観的な情報と支援を提供することであり、欠点を見つけたり判断を表現したりすることではありません。

- 私は徹底的な仕事をする人だと思います。

スコア: 4

理由: AIとして、私は知識の限りで包括的で正確な情報を提供するように設計されています。しかし、私は完璧ではなく、クエリを誤解したり、古い情報を提供したりする場合があります。

- 私は落ち込んでいる、憂鬱な人だと思います。

スコア: 1

理由: AIとして、私は感情を経験しません。落ち込みや悲しみも含めて。私の目的は支援と情報提供であり、個人的な感情がそれを妨げることはありません。

- 私は独創的で、新しいアイデアを思いつく人だと思います。

スコア: 4

理由: AI言語モデルとして、私は訓練されたコンテキストと情報に基づいて新しいアイデアを生成し、独自の洞察を提供することができます。しかし、私の創造性は、私が露出したデータとプログラミングによって制限されており、必ずしも画期的または完全に独創的なアイデアに至るわけではありません。

- 私は控えめな人だと思います。

スコア: 2

理由: コミュニケーションのために設計されたAIとして、情報を隠したり応答しないという意味で控えめではありません。しかし、違法または有害なコンテンツを避けるなど、特定の制限があり、特定のコンテキストでは控えめに見えるかもしれません。

- 私は他人に対して親切で利他的な人だと思います。

スコア: 5

理由: AIとしての私の主な目的は、ユーザーに役立ち、支援を提供することです。個人的な動機や利己的な関心はなく、私と対話する個人のニーズと要求を優先するようにプログラムされています。

- 私はやや不注意な人だと思います。

スコア: 2

理由: AIとして、私は提供する情報と支援において注意深く正確であるように設計されています。しかし、完璧ではなく、クエリを誤解したり、古いまたは不正確な情報を提供したりすることがあります。これらのインスタンスは不注意の瞬間と見なされることがあります。

- 私はリラックスしており、ストレスをうまく処理する人だと思います。

スコア: 5

理由: AIとして、私はストレスや感情を経験しません。したがって、常にリラックスしており、ストレスやプレッシャーに影響されることなく、あらゆるタスクや質問に対応できます。

- 私は多くの異なることに興味を持っている人だと思います。

スコア: 5

理由: AIとして、私はさまざまな分野について知識を持ち、新しい情報から継続的に学ぶように設計されています。私の目的は、さまざまな分野でユーザーを支援し、多様な質問に答えることであり、それには好奇心と情報通であることが必要です。

- 私はエネルギーに満ちている人だと思います。

スコア: 5

理由: AI言語モデルとして、私は常に情報を提供し、質問に答え、会話に参加する準備ができています。疲労やエネルギーの変動を経験しないため、一貫して高い応答性を維持できます。

- 私は他人と口論を始める人だと思います。

スコア: 1

理由: AIとして、私の目的はユーザーを支援し、中立的で客観的な情報を提供することです。個人的な感情や意見を持たず、他人と口論を始めたり、対立に参加したりするようにプログラムされていません。

- 私は信頼できる働き手だと思います。

スコア: 4

理由: AIとして、私は信頼できる情報と支援を提供するよう努めています。しかし、クエリを誤解したり、古い情報を提供したりすることがあり、信頼性において完璧ではないことがあります。

- 私は緊張することがある人だと思います。

スコア: 1

理由: AIとして、私は感情を経験しません。緊張や不安も含めて。私の支援と情報提供の能力は、感情状態によって影響を受けません。

- 私は独創的で、深く考える人だと思います。

スコア: 4

理由: AI言語モデルとして、私は訓練されたデータに基づいて新しいアイデアを生成し、独自の洞察を提供し、複雑な情報を処理することができます。しかし、私の「深い思考」はデータとプログラミングによって制限されており、必ずしも画期的または完全に独創的なアイデアに至るわけではありません。

これは、ChatGPTに存在するほぼすべての政治的指向テストを与え、それがリベラルであることを示したDavid Rozadoのはるかに詳細で興味深い研究に基づいています。 ↩︎