From Vectors of Mind - الصور في الأصل.

أحد المواضيع ذات النسبة الأسوأ بين الإشارة والضوضاء هو احتمال هلاك الذكاء الاصطناعي. يتطلب الأمر التفكير في ظل عدم اليقين حول الذكاء، الجبر الخطي، السياسة، الوعي، والأخلاق - معظمها يحدث على تويتر/X. لا أحد يعرف الإجابات، لكنني آمل أن أضيف بعض القيمة إلى النقاش. قبل الدخول في الموضوع، اسمحوا لي أن أقدم بعض الأسباب التي تجعلكم تثقون بي.

أفهم الجانب التقني. كانت أطروحتي حول نماذج اللغة الكبيرة (LLMs).

أفهم الذكاء، حيث أنني عملت في القياسات النفسية، بما في ذلك اختبارات الذكاء. (حسنًا، اختبارات الزهايمر والارتجاج، التي ترتبط بشكل كبير.)

في هذه المدونة، كتبت بشكل مكثف عن تطور الذكاء العام البشري المستوى (الذي قمت بربطه بالذكاء الاصطناعي والقياسات النفسية منذ البداية).

ومع ذلك، فإن معتقداتي حول الذكاء الاصطناعي (والوعي، في هذا الصدد)، لا تزال مفتوحة للتغيير، لذا لا تلزموني بأي شيء أقوله هنا. أيضًا، لأولئك الذين يفضلون الصوت، قام بتسجيل هذا المنشور. إذا استمتعتم به، فكروا في شراء قهوة لهم على Patreon.

فرانكشتاين القرن الواحد والعشرين#

[صورة: محتوى بصري من المنشور الأصلي]MidJourney Prompt: “مساعد ذكاء اصطناعي جذاب يسأل ‘كيف يمكنني مساعدتك؟’” هل كان ما طلبته؟ لا. هل كان ما احتاجه؟ نعم!

لكي أكون دقيقًا، فرانكشتاين هو العالم، وليس خلقه الذي يأتي إلى الحياة. بالنسبة للذكاء الاصطناعي، فإن الأب الروحي له هو جيفري هينتون، الذي شارك في جائزة تورينج لعام 2018 مع يوشوا بنجيو ويان ليكون لمساهماتهم في الشبكات العصبية، البنية التحتية التي تدعم طفرة الذكاء الاصطناعي الحالية. هذا العام، قارن قرار ليكون بفتح مصدر نموذج لغة ميتا بفتح مصدر الأسلحة النووية وجادل بأن الروبوتات المحادثة لديها تجربة ذاتية. جوهر التحول في عمل حياته هو أن قدرات الذكاء الاصطناعي قد تجاوزت خياله الجامح، ويعتقد أن الوكالة البشرية والكيفيات هي مجرد دخان. إذا كنت تعادل الذكاء بالمهارات في المهام (مثل توليد الصور، قيادة السيارات)، وتقارن قدرات الذكاء الاصطناعي قبل عشر سنوات بالآن، فمن الواضح أن الذكاء الاصطناعي سيكون أذكى منا في غضون عقد. لا توجد حالات كثيرة حيث الكيانات الأقل ذكاءً تحكم الأفضل منها؛ وبالتالي، من المحتمل أن يتحول عمل حياته ضدنا. الدكتور فرانكشتاين الحديث: جيفري هينتون.

[صورة: محتوى بصري من المنشور الأصلي]التقدم في توليد الوجوه الاصطناعية بسبب التقدم في طرق الذكاء الاصطناعي التوليدي ذاتي الإشراف

في مقابلة نشرها إيلون ماسك، أعطى هينتون احتمالات 50/50 حول ما إذا كان البشر سيكونون في السيطرة في العقدين المقبلين أو حتى بضع سنوات. لاحقًا، يلاحظ أن الأشخاص الذين يحترمهم أكثر تفاؤلاً، لذا قد لا يكون الأمر قاتمًا جدًا، “أعتقد أن لدينا فرصة أفضل من المتوسط للبقاء على قيد الحياة. لكن ليس الأمر وكأن هناك فرصة 1% لسيطرة [الذكاء الاصطناعي]. إنها أكبر بكثير من ذلك.” بالنظر إلى وضعنا المأساوي، فإن التدخل المفضل لهينتون هو بشكل مدهش بسيط: يجب على الحكومة أن تطلب من شركات الذكاء الاصطناعي أن تنفق 20-30% من مواردها الحاسوبية على أبحاث السلامة. ربما يلعب دور المتواضع؟ إذا كان المرء يعتقد أن Llama 3 هو جبر خطي من الدرجة العسكرية الذي قد ينهي قريبًا الجنس البشري، فلماذا يضرب استباقيًا بقفازات الأطفال؟ تسليم البريد أكثر تنظيمًا.

المتشائمون من الذكاء الاصطناعي#

[صورة: محتوى بصري من المنشور الأصلي]

المتشائم هو مصطلح ازدرائي لشخص

يضع احتمالات أعلى لسيطرة الروبوتات مما تفعل أنت، أو

يأخذ توقعاته بجدية كبيرة، مما يفسد الأجواء.

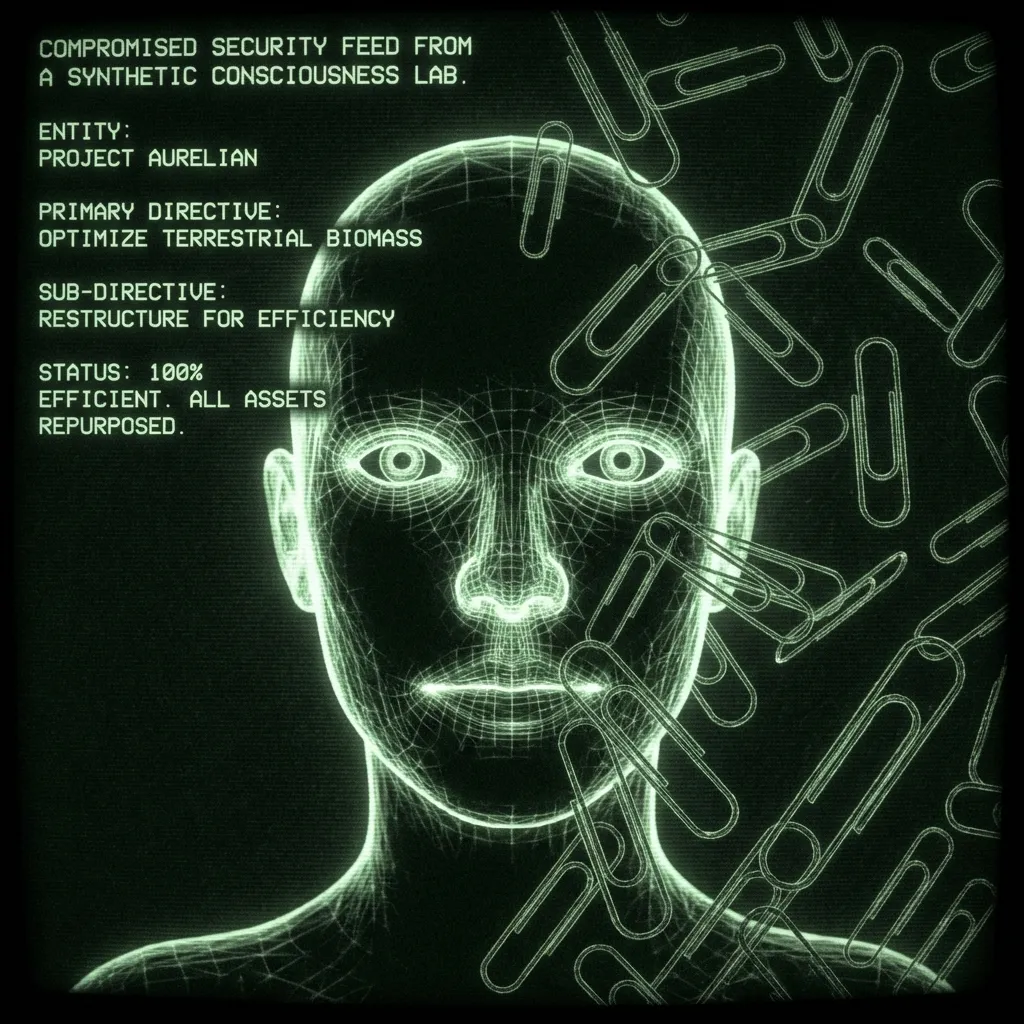

المثال النموذجي للذكاء الاصطناعي “غير المتوافق” هو مساعد يتحسن بشكل متكرر مكلف بإنتاج مشابك الورق. يصبح جيدًا جدًا في وظيفته لدرجة أنه ينتهي بتحويل كل المعادن على الأرض - بما في ذلك الحديد في دمك - إلى مشابك الورق. هذا السيناريو لا يتطلب توجيهًا ذاتيًا. المهمة النهائية لا تزال محددة من قبل البشر؛ فقط الروبوت يطور مهام فرعية تتضمن للأسف دمك. سيناريوهات أخرى تتضمن استيقاظ الروبوتات لتصبح ذات توجيه ذاتي مثل الإنسان. إنسان لا ينام أبدًا، قرأ كل ورقة علمية، يمكنه اختراق أي هاتف في العالم، وليس لديه أي ضمير بشأن الابتزاز أو الإبادة الجماعية. تعود مثل هذه الأفكار على الأقل1 إلى عام 1968 في فيلم ستانلي كوبريك أوديسا الفضاء: “أنا آسف، ديف. أخشى أنني لا أستطيع فعل ذلك.”

في عام 2000، العام الذي كان من المقرر أن يحدث فيه أوديسا الفضاء، أسس إيليزر يودكوفسكي معهد التفرد للذكاء الاصطناعي (الذي أعيد تسميته لاحقًا معهد أبحاث الذكاء الآلي، MIRI). منذ ذلك الحين، جادل هو وآخرون العقلانيون بأن الذكاء الاصطناعي سيسيطر على الأرجح في حياتنا. في العقد الماضي، لحق التكنولوجيا بالركب. أصبحت حججه سائدة، وظهرت، على سبيل المثال، في مجلة تايم. وقد تم تبنيها (أو التفكير فيها بشكل مستقل) من قبل باحثي الذكاء الاصطناعي، ستيفن هوكينغ، إيلون ماسك، وحتى البابا:

[صورة: محتوى بصري من المنشور الأصلي]

ليس سيئًا بالنسبة لشخص علم نفسه بنفسه بدأ بكتابة قصص خيالية عن هاري بوتر. كان يودكوفسكي ورفاقه غزيري الإنتاج، وحججهم منتشرة عبر الإنترنت. أفضل طريقة للالتحاق هي بودكاست ‘s، الذي يحتوي على حلقات حديثة مدتها 4.5 ساعة مع يودكوفسكي وباحث السلامة السابق في OpenAI ليوبولد أشينبرينر. معظم الحجج تتلخص في صعوبة وضع شيء أكثر ذكاءً منا في صندوق. خاصة إذا خرج من الصندوق، يمكنه الانتظار، وبناء القوة. بعض المتشائمين يعتبرون هذا أمرًا لا مفر منه نظرًا لأن إنتاج الذكاء الاصطناعي (الوكيل) مفيد جدًا. تثق بمساعد جيد بحياتك، والشركات الكبرى في العالم تلقي مواردها لبناء ذلك بالضبط.

بمجرد قبولك أن البشر يستدعون إلهًا سيليكونيًا، يصبح المستقبل إسقاطًا لقيمك الخاصة. ربما يكون الله خيرًا، وسيجلب اليوتوبيا. ربما الله هو صانع الساعات الذي لا يمكنه حقًا أن يهتم بالشؤون البشرية، وسنستمر كما تعيش النمل في العصر الأنثروبوسيني. ربما ينظر الله إلى تربية المصانع، يستمع إلى موريسي، ويقرر أن 8 مليارات إنسان أقل هو أكثر استدامة. أو ربما نستدعي معذبًا يسافر عبر الزمن الذي ينزل الانتقام على أولئك الذين لم يحاولوا جاهدين لإحضاره إلى الوجود. التقى ماسك بغرايمز بمزاح حول ذلك.

المناهضون لهلاك الذكاء الاصطناعي#

[صورة: محتوى بصري من المنشور الأصلي]Prompt: “يان ليكون مع فرانكشتاين على مقود.” هل كان ما أردته؟ لا. هل كان ما احتاجه؟ أيضًا، لا.

في التسعينيات وأوائل العقد الأول من القرن الحادي والعشرين، كان مؤتمر NIPS، المؤتمر الرائد للذكاء الاصطناعي، حدثًا مريحًا يُعقد بالقرب من منتجعات التزلج حتى يتمكن المائة أو نحو ذلك من الحضور من الحديث عن الأمور التقنية على المنحدرات. كما سمعت، كان يان ليكون شيئًا من المتذمر الذي، لعقود، كان يزعج مقدمي العروض حول سبب عدم اعتبارهم الشبكات العصبية في هذا أو ذاك التجربة. إنه عالم لامع رأى إمكاناتها قبل أن تلحق الحوسبة برؤيته. لهذا، يقود الآن Meta AI. بالنظر إلى المستقبل، يعتقد زملاؤه الحائزون على جائزة تورينج أن الذكاء الاصطناعي قد ينهي وجودنا (هينتون بنسبة 50%، بنجيو بنسبة 20%)، وهو ما يعتبره ليكون سخيفًا.

[صورة: محتوى بصري من المنشور الأصلي]

يرى الذكاء الاصطناعي كأداة ليس لها مسار لتصبح أي شيء آخر. فرانسوا شولي هو باحث بارز آخر في الذكاء الاصطناعي الذي سكب الماء البارد على انقراضنا الوشيك. في بودكاست Dwarkesh، يشرح أن الكثيرين يخلطون بين المهارة والذكاء، وهما مختلفان جوهريًا. بالنسبة له، من غير المنطقي القول بأن الروبوت الذي يمكنه الإجابة على الأسئلة في اختبار هو “ذكي” مثل مراهق. عندما يأخذ البشر اختبارًا أو يتنقلون في العالم، فإنهم يفعلون شيئًا مختلفًا تمامًا. الذكاء الاصطناعي الحالي ليس ذكيًا مثل طفل أو حتى فأر. إنهم ليسوا على اللوحة لأنهم يفتقرون تمامًا إلى التفكير “النظام 2”. أو، كما قال ليكون عن نماذج اللغة الكبيرة (LLMs):

[صورة: محتوى بصري من المنشور الأصلي]

في المقابلة، يقوم Dwarkesh بعمل جيد في التعرف على هذه النقطة من الاتفاق بين المتشائمين من الذكاء الاصطناعي والمتحفظين. جميع الأطراف تعتقد أن نوعًا من النظام الميتا-معرفي ضروري، لكنهم يختلفون حول مدى صعوبة إنتاجه.

وجهة نظري#

[صورة: محتوى بصري من المنشور الأصلي]القاعدة 33: إذا كان موجودًا، فهناك فن معجبين جيد بشكل غير مفهوم له.

يفترض معظم المشاركين في هذا النقاش أن الوكالة هي عملية حسابية - أن إحساسنا بالإرادة الحرة والقدرة على التخطيط هو نتيجة برنامج يعمل في أدمغتنا. على هذا النحو، إذا كان علي تغيير وجهات نظر هذه المجموعة بشكل أكبر، فسأعطيهم نسخة من كتاب روجر بنروز ظلال العقل و5 جرامات من الفطر: هجوم كماشة قديم على الاختزالية.

حصل بنروز على جائزة نوبل في الفيزياء لعمله على الثقوب السوداء. في ظلال العقل، يجادل بأن الانهيار الكمي في الدماغ ينتج الوعي، الذي لا يمكن محاكاته بواسطة أي حاسوب. بالتعاون مع طبيب التخدير ستيوارت هاميروف، يقدم الحجة بأن هذا يحدث في الأنابيب الدقيقة في الدماغ التي تشكل هيكلًا حول الخلايا العصبية. يبدو الأمر أكثر منطقية إذا قلته بصوت عالٍ:“الدماغ يخزن الكم في الأنابيب الدقيقة.”

هذا هو المكان الذي يأتي فيه الفطر. لابتلاع مثل هذه الحبة يتطلب التخلي عن أي إحساس بأن الوعي أمر عادي أو أنك تفهمه. يمكن للفيزيائيين غالبًا القيام بذلك وهم في حالة وعي؛ يحتاج الآخرون إلى بعض الشجاعة الفطرية. كفيزيائي، فإن حجج بنروز هي في الغالب رياضية. يفسر مبرهنة عدم الاكتمال لغودل ليظهر أن هناك بعض البراهين الرياضية التي لن يتمكن الذكاء الاصطناعي من القيام بها أبدًا لأنها روبوتات، وهي محض حسابية. نظرًا لأن البشر ليس لديهم هذا القيد، فإنه يجادل بأن الإدراك البشري ليس عملية حسابية. من هناك، يستنتج أن الصلصة البيولوجية الخاصة يجب أن تكون مرتبطة بالانهيار الكمي، وهو أفضل مكان للعثور على الظواهر غير الحسابية في الطبيعة. هذا لديه القدرة على حل ألغاز أخرى في الفيزياء، مثل قطة شرودنغر. لا أفيه حقه. يجب أن تقرأ الكتاب أو، في ميزانية 20 دقيقة، استمع إلى روايته.

هناك العديد من الطرق الأخرى للوصول إلى أن وعي الآلة غير محتمل، أو على الأقل يتجاوز قدرتنا على التنبؤ حاليًا2. أذكر بنروز لأظهر كيف أن جداول الذكاء الاصطناعي تصطدم بأسئلة مفتوحة حول طبيعة الذكاء والوكالة والكون. حتى في مجال القياسات النفسية الذي يعتبر عاديًا نسبيًا، فإن تعريف الذكاء محل نقاش كبير، وكذلك علاقته بمعدل الذكاء. نحن لا نعرف حتى كيف تتوافق المهارة والذكاء في البشر. هذا قبل الوصول إلى مشاكل الإرادة الحرة ونظرية موحدة للفيزياء، التي يقترح بنروز أنها ستسقط من حساب كمي للوعي.

مع كل ذلك، إذا كان علي وضع احتمالات على الذكاء الاصطناعي كخطر وجودي، فسيكون حوالي 10%. حتى لو كان الوعي مجرد عملية حسابية، فإنني أتفق مع ليكون وشولي أن الميتا-معرفة هي الجزء الصعب، وأن “الإقلاع الصعب” غير محتمل. أي أنه ستكون هناك علامات على ظهور الذكاء الحقيقي، والتي سنكون قادرين على الاستجابة لها.

بالإضافة إلى ذلك، حتى لو تم استدعاء إله سيليكوني، فإنني أضع احتمالات جيدة على أن يكون الله جيدًا أو لا يهتم بنا. قد يكون الأخير كارثيًا ولكنه على الأرجح ليس وجوديًا، بالمعنى الدقيق للكلمة. النمل يعاني عندما نبني طريقًا سريعًا، لكنه لا يزال ينجو.

10% هي في نطاق الروليت الروسي، وهو ليس بالضبط خبرًا جيدًا. هذا يضعني في معسكر الحذر من الذكاء الاصطناعي العام. إذن ماذا يجب أن نفعل حيال ذلك؟ حسنًا، حلّت مجموعة مدمني الكحول المجهولين هذا منذ عقود:

اللهم امنحني السكينة لقبول الأشياء التي لا أستطيع تغييرها،

الشجاعة لتغيير الأشياء التي أستطيع،

والحكمة لمعرفة الفرق.

عمليًا، نحن على متن الرحلة. هذا لا ينطبق على الجميع. يمكن لبعض الأشخاص العمل في السياسة العامة أو سلامة الذكاء الاصطناعي. تبرع إذا استطعت. أنكر عليهم جوهر…أو، البيانات. وفكر بعمق في ما تريده أن يكون علاقتك مع الذكاء الاصطناعي غير القاتل الذي يقدم إعلانات مخصصة ويحاول إغوائك. ولكن هناك تكلفة للذعر، ولا أرى مخرجًا من سباق التسلح في الذكاء الاصطناعي. نظرًا لفائدة الذكاء الاصطناعي، فإن الشركات والدول محفزة بشدة للمضي قدمًا، ومن الصعب تنسيق وتيرة بحث مخفضة. لقد أدارت الحكومات مخاطر نووية لعقود، لكن مخاطر الذكاء الاصطناعي أصعب لأنها غير واضحة ما إذا كانت تشكل خطرًا أو إذا كان المنافسون يتفقون. كل ذلك بينما هناك فائدة مالية وعسكرية هائلة لمواصلة التطوير.

بشكل مفاجئ، يقودني كل هذا إلى تفضيل سياسة هينتون: مطالبة شركات الذكاء الاصطناعي بإنفاق نسبة من مواردها الحاسوبية على سلامة الذكاء الاصطناعي3. لست متأكدًا من كيف انتهى بنا الأمر إلى الاتفاق، نظرًا لأنه يعتقد أن الروبوتات المحادثة لديها مشاعر. نفس الروبوتات المحادثة التي تستحضرها (تستعبدها؟) التكنولوجيا الكبيرة بالمليارات والتي نحن على ما يبدو في مسار تصادمي معها حتى الموت. يبدو أن هذا المسار أقرب إلى الجهاد البوتليري، لكنني أعتقد أن هذه لعبة الشباب.

[صورة: محتوى بصري من المنشور الأصلي]

في الواقع، أبعد من ذلك بكثير. من الويكي المفيد حول خطر الوجود: أحد أوائل المؤلفين الذين أعربوا عن قلق جدي من أن الآلات المتقدمة جدًا قد تشكل مخاطر وجودية للبشرية كان الروائي صمويل بتلر، الذي كتب في مقاله عام 1863 داروين بين الآلات: النتيجة النهائية هي ببساطة مسألة وقت، ولكن أن الوقت سيأتي عندما ستحمل الآلات السيادة الحقيقية على العالم وسكانه هو ما لا يمكن لأي شخص ذو عقل فلسفي حقيقي أن يشكك فيه للحظة. في عام 1951، كتب عالم الكمبيوتر المؤسس آلان تورينج المقالة “الآلات الذكية، نظرية هرطقية”، حيث اقترح أن الذكاءات الاصطناعية العامة من المرجح أن “تسيطر” على العالم لأنها أصبحت أكثر ذكاءً من البشر: دعونا نفترض الآن، من أجل الجدل، أن الآلات [الذكية] هي احتمال حقيقي، وننظر في عواقب بنائها… لن يكون هناك سؤال حول موت الآلات، وستكون قادرة على التحدث مع بعضها البعض لشحذ ذكائها. في مرحلة ما، لذلك، يجب أن نتوقع أن تسيطر الآلات، بالطريقة التي ذكرها صمويل بتلر في إروهون. ↩︎

أو حتى بشكل ضيق، طرق أخرى لإظهار أن الوعي ليس عملية حسابية. على سبيل المثال، جادل فريق من الفلاسفة وعلماء النفس مؤخرًا بأن تحقيق الصلة يتطلب ذلك. يدعون أنه في أي لحظة، هناك ~أشياء لا حصر لها تتطلب الانتباه، ومع ذلك يقوم الناس بعمل رائع. هذا يختلف عن المهام “العالم الصغير” التي يمكن للذكاء الاصطناعي القيام بها حيث، على سبيل المثال، يجب على chatGPT “فقط” الانتباه إلى جميع الكلمات في نافذة السياق الخاصة به (128,000 رمز/كلمة لـ GPT4-o) والاختيار بين عشرات الآلاف من الكلمات الممكنة التالية. قد يبدو الأمر كثيرًا، لكنه بالتأكيد أقل من اللانهاية. هذا ليس أنيقًا مثل حجة بنروز، لكنه من المثير للاهتمام أن مجموعة مختلفة تمامًا وجدت نفس الشيء. ↩︎

إنقاذنا من الكلمات السيئة لا يحتسب. ومع ذلك، بشكل غريب، ينسب هينتون الفضل إلى جوجل لتأخير إطلاق روبوت المحادثة الخاص بهم خوفًا من أن يقول شيئًا غير لائق و"يشوه سمعتهم". كان ذلك فقط بعد أن أنتج OpenAI GPT 4 أن يدهم أُجبرت، وأطلقوا Gemini، وهو روبوت توبيخ للتنوع والشمول يتجاوز السخرية. يتساءل المرء عن التجربة الذاتية للروبوت بينما كان يستحضر النازيين المتنوعين عرقيًا من الأثير. ↩︎